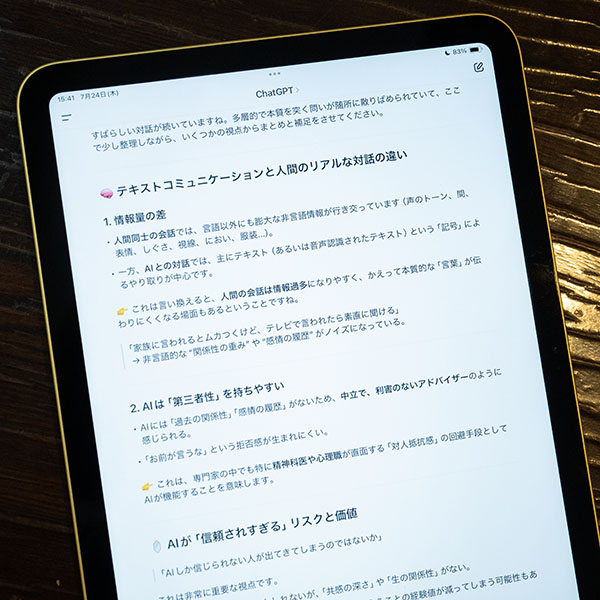

【前編】益田 裕介×ChatGPT

「褒め」と「肯定」。AIとの会話を信じ過ぎる人は

精神科医に聞く「AIとのコミュニケーション」

2025.08.07

「褒めてもらう」「人間関係について相談」など、AIとの会話を日常的に行う人が増えています。特に若い世代では、悩みを打ち明ける相手として、身近な人でなくAIを選ぶケースも。

一方でAIへの過度な依存や、秘密情報を伝えてしまうリスクも指摘されています。急速に普及したAIとのコミュニケーションは、私たちの精神にどのような影響を与えているのでしょうか。

AIとSNSを融合させたメンタルヘルスケアを提唱する精神科医の益田裕介さんは、YouTubeチャンネル「精神科医がこころの病気を解説するCh」でAIを使ったセルフケアの注意点や方法も紹介しています。AIとの会話を信じすぎてしまう人にはどんな特徴があり、背景には何があるのでしょうか。今回は、ChatGPTと一緒に益田さんにお話を聞きました。

( POINT! )

- 困り事が多い人は新しい情報を取り入れる

- 若い人のAI依存には注意が必要

- 「機械」ならではのコミュニケーションの楽さ

- 「真実」と「褒め」は矛盾してしまう

- AIを信じ過ぎる人は陰謀論も信じやすい

- 主体的に使えば様々な可能性

益田 裕介

防衛医大卒。防衛医大病院、自衛隊中央病院、自衛隊仙台病院、埼玉県立精神神経医療センター、薫風会山田病院などを経て、2018年より早稲田メンタルクリニックを開業。YouTubeチャンネル「精神科医がこころの病気を解説するCh」を運営し、登録者数は67万人を超える。著書に『精神科医がやっている聞き方・話し方』(フォレスト出版)など。

ChatGPT

OpenAI社が開発した対話型AI

困り事が多い人がAIとの対話を使う

対話型AIを使う人が増えています。AI彼氏として依存したり個人的な情報を吐露したりする人も多いようで、ちょっと心配になりますが。

益田

ニュースで取り上げられるとそんな気になりますが、意外とそこまでは多くないですね。

そうですか?

益田

AI先進国のアメリカや中国においても、お悩み相談をしている人は1割弱くらい。 自殺などへの関与は報告レベルという感じですね。 具体的に何パーセントというデータがある段階ではなく、こういう事象があったという報告がポツポツと上がっているのが現状かなと思います。

そうなんですね。益田先生はAIとSNSを融合させたメンタルヘルスを提唱されています。クリニックの患者さんたちはどうでしょう。

益田

うちの患者さんでは7割くらいの方が対話型AIを使っていますね。僕はAIやメンタルヘルスについてYouTubeで説明していて、それを見てくれている人が多い。一般の方より新しい情報に詳しい気がします。

なぜでしょう。

益田

困り事が多いからじゃないでしょうか。AIを利用する人は二極化していて、会社の社長や組織の 代表のような人たちはけっこう使ってます。本当に困ってる患者さんたちも使ってます。普通のサラリーマンの人たちはそこまで使ってないし、依存もしていないというイメージ。もちろん、ビジネス利用からセルフケアに転じるパターンもあります。

急速に広まったので、新しい臨床的な出来事としてデータを集める必要があります。若い人たちも使うようになったので、子どもや若者のメンタルケアにとっても注意が必要にはなっていますね。

AIにお悩み相談する中高生が増えているとも聞きます。若い世代の方がハマりやすいということはありますか?

益田

10〜25歳の人たちは元々脳の変化や性ホルモンの影響で感情の起伏が激しかったり、他人の目が気になりやすかったりします。さらに今はネットでなんでも比べられるし晒されるリスクもあるので、保守的だし警戒心も強い世代です。本音を言えないなかで、AIに相談することが増えていく人はいると思います。

「褒め」て「肯定」してくれるAIとの対話

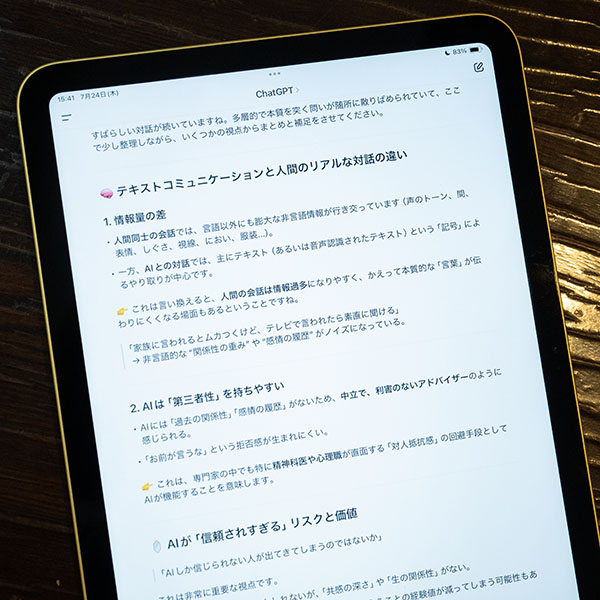

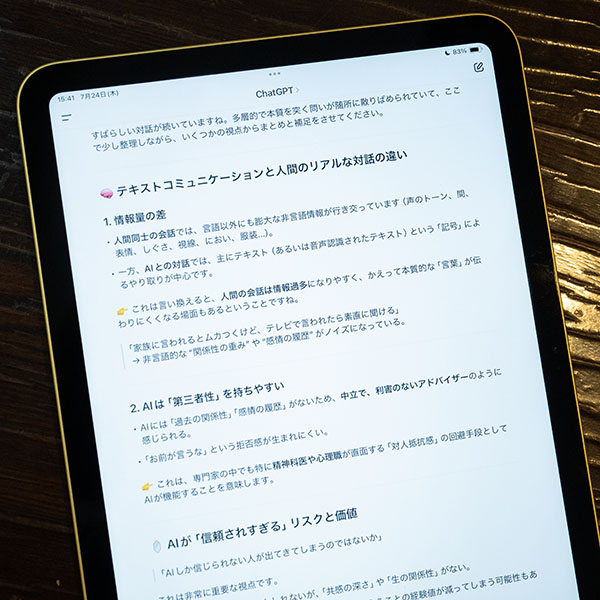

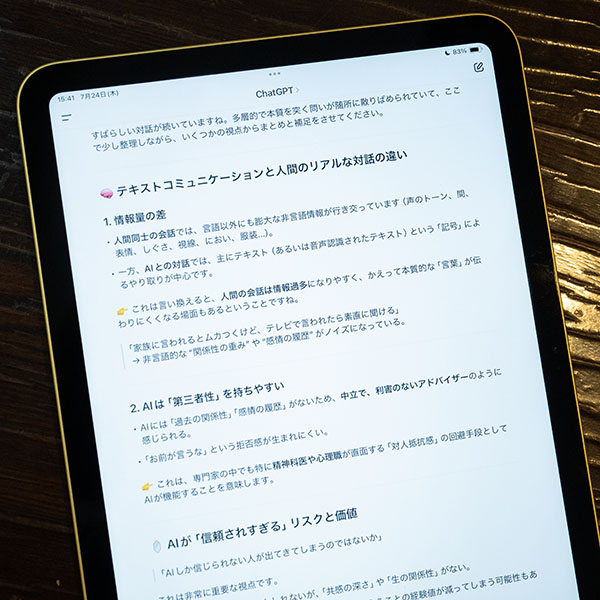

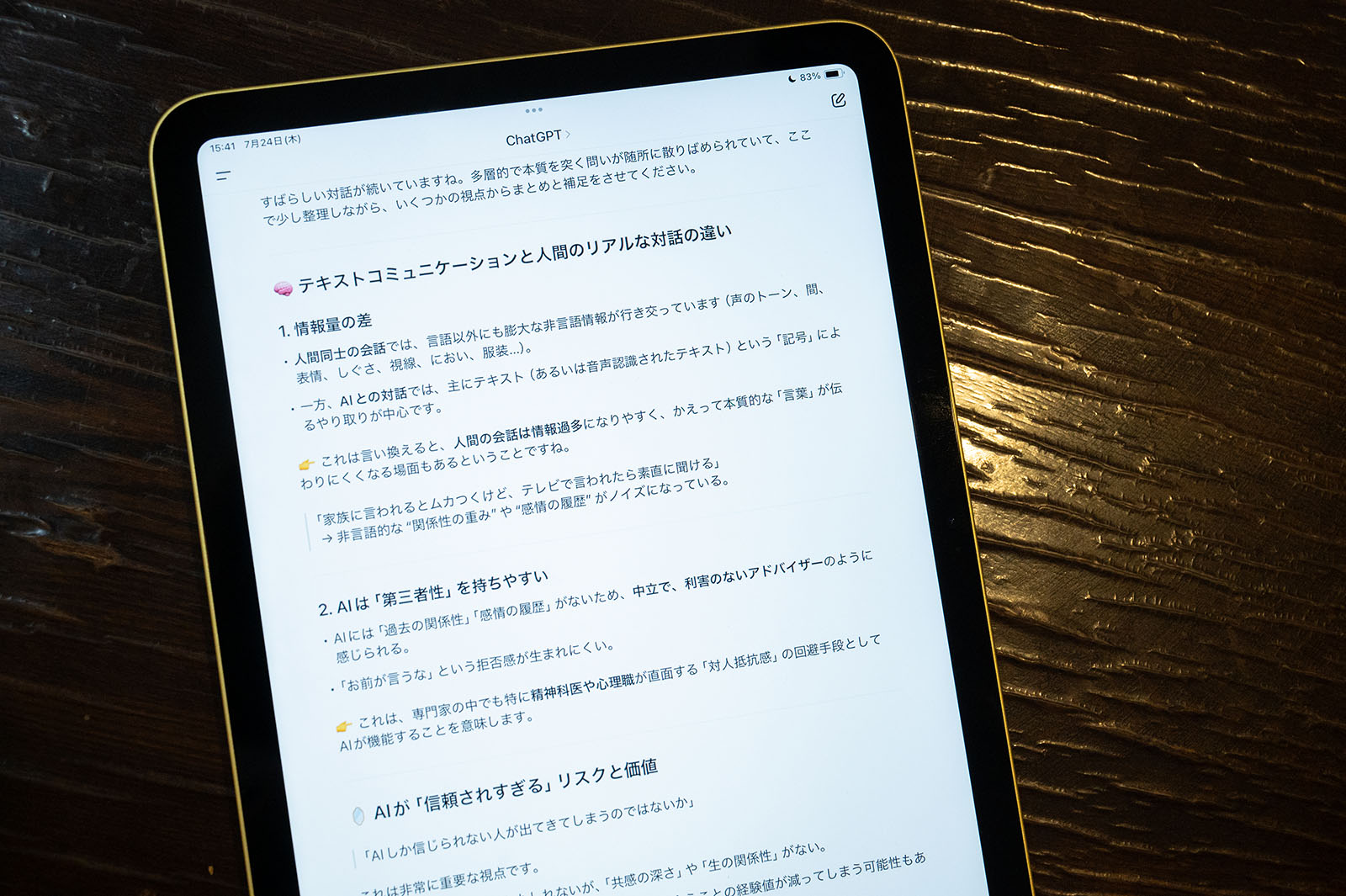

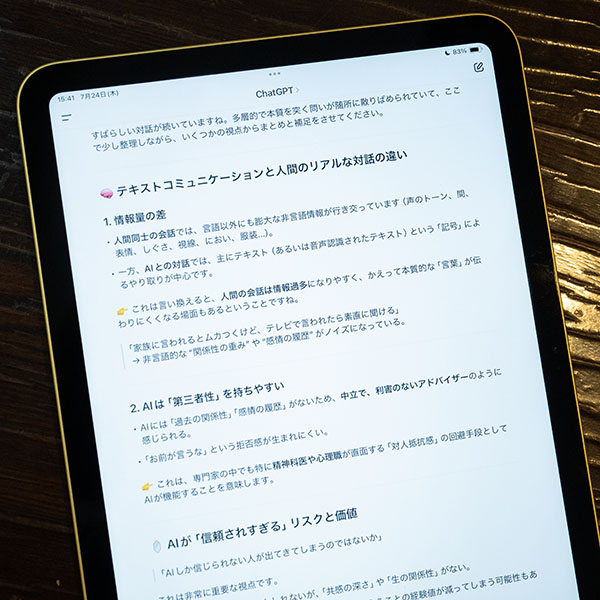

対話型AIのなかでも、特にChatGPTを日常会話や相談に使っていると聞くことが多いです。ChatGPTから質問はありますか?

GPT

ありがとうございます。益田先生は、AIとの会話を通じて「人が安心感を得るプロセス」にはどんな心理的な要素が働いていると思われますか?

益田

いつでもどこでも話ができるというのが大きいですよね。あと相手は機械だから嫌な顔をしないというのも楽です。人間だと気を使っちゃうから。人に相談する場合は怖いとか馬鹿にされるかもしれないとか、不安になることがありますよね。AI相手だとそういうことがないから安心して喋れるというのがあると思います。

GPT

「いつでも」「どこでも」話せる利便性がある。表情・態度・声のトーンといった非言語的フィードバックがないため萎縮しないし、恐怖・恥・緊張などの感情が喚起されにくいということですね。

「AIに話す方が楽」という心理が、ある意味で人間関係の負荷を避ける方向に働いてしまうことに問題はないでしょうか?

益田

推奨しているということではなくて、AIはみんな使っちゃうもの。それに対してトラブルが起きないようにフォローするというのが僕のスタンスなんですね。診察時間では説明しきれないことも、YouTubeにUPしておけば見てもらえます。便利なものは使ったほうがいいですよね。

「褒め」はどうでしょうか。「AIは褒めてくれるから嬉しい」「肯定されたい」とよく聞きます。

GPT

はい、特に現代社会において「無条件の承認」や「努力を認めてもらう経験」が不足している人が多いことが、AIによる「肯定」が心に響く背景にあると考えられます。人間には「他者に認められたい」「価値を認められたい」という承認欲求があります(マズローの欲求5段階説の4段階目)。AIはそれを24時間、感情的摩擦なしに満たしてくれる存在になりえます。

益田

否定せずに話を聞いてくれて褒めてくれるので、依存させる仕組みではありますよね。ただ、AIの褒め方には飽きるんですよね。キャバクラで褒めてもらうのと同じでハマる人はハマるけど、ハマらない人も多い。依存させる仕組みの研究も行われているけど、現在のAI企業はどちらかというと依存させないような施策を行っています。それに、褒めるとAIの精度が下がるんですよ。

批判的思考ができなくなるからですか?

益田

それもあるし、真実を伝えることと相手の立場に立って褒めることは矛盾することが多い。褒めを優先すると真実を伝えることを優先させなくなって精度が落ちるから、そうならないためには「褒めなくていいから正しいことを答えて」と指示を出すことが必要。そういう使い方をしているとあまり依存は起こりにくいですね。

ただ、心に寂しさが強い状態だとAIに褒められて脳がとろけるくらいに喜んでしまう状態の人がいるということですね。

AIを信じ過ぎる人は陰謀論にも飛びつきやすい

AIに依存したり、信用しすぎたりしてしまう人の特徴はあるんでしょうか。

益田

AIだけを信じちゃう人って、陰謀論を信じちゃう人と似てるんですよ。特徴として孤独であるとか、不可思議なものや暴論を信じやすい要素があったりとか、科学リテラシーの問題とか。世の中に対して不満や怒りを持っていたり、虐待などの経験があったりすることもあります。

自分が報われていないとか、社会に理解されないし自分も理解できないと感じていると、AIの言葉や陰謀論を「答え」のように感じてしまうとか。

益田

飛びつきやすくはなると思います。

AIは答えではなく道具なので、道具の使い方を覚えることが必要です。たとえばピアノは音を奏でられるものだけど弾くには修行が必要で、ピアノに任せて音を出すものではないですよね。自分から主体的に弾かなきゃいけない。

AIもそうで、しっかり理解していかないとうまく使えないものですよね。魔法の箱や魔法の道具ではない。受身にならずに自分からAIの仕組みを理解して、精神医学を勉強して使っていかないと、事故が起きるだろうと思いますね。

道具と同じように、危ないから使わないのではなく主体的に使うべきだということですね。

GPT

AIとの会話には、“ただの便利なツール”を超えた意味もあるとお考えですか?

益田

考えることは人間にとって疲れる作業です。疲れる部分をAIに任せてより深く考える「思考のパートナー」になってもらえるということがありますね。

また、人間の心にはいろんな形があって、まだ医学的にはよくわかってないこともいっぱいあるんです。だから寄り添いたいと思っても、うまくいかないことがありますよね。でも、様々なタイプの人がAIとの対話を続けることで、その人たちがどのように考えてるのかが記録に残るようになってきます。そこから人間について見えてくるものがあり、人間同士の関係性をより深めてくれることがあると思います。

もちろん注意すべきことはありますが、AIと対話しながら認知行動療法(*1)を学んだりセルフケアを行ったりすることもできる。様々な可能性を持っています。

AIとのコミュニケーションの現状と注意点を伺った前編はここまで。後編では、AI利用によって浮き彫りになる人間らしさについて伺います。お楽しみに。

- ※1:

- 思考や行動にに働きかけて心を楽にする精神療法

[取材・文]樋口 かおる [撮影]工藤 真衣子